ИИ-чипы и новые процессоры 2026: что это значит для DIY-электроники

11

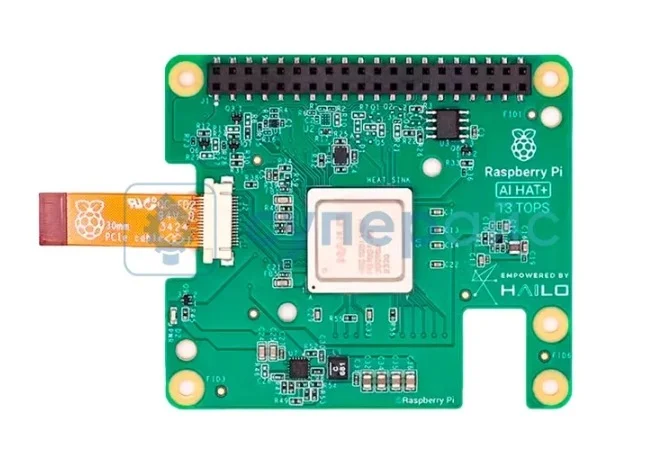

11 В 2023 году, чтобы добавить в проект «искусственный интеллект», нужно было арендовать облако, настроить сеть, оболочку и молиться, чтобы задержка передачи данных не убила весь пользовательский опыт. В 2026 году STM32 со встроенным нейросетевым ускорителем (NPU) стоит меньше чашки кофе. Что-то явно изменилось. STM32N6 с 600 GOPS, Ambiq Apollo 5 с микроваттным инференсом, Raspberry Pi AI HAT+ с 13 TOPS — всё это можно купить и поставить на макетку прямо сейчас.

Конечно, вы не получите аналог умной «Алисы» в кармане. Это другой AI — локальный, быстрый, экономный. Его задача — распознавание ключевых слов, жестов, простая классификация изображений. Всё это без интернета, без задержки, без подписки.

В статье рассказываем, что на самом деле скрывается за аббревиатурами NPU и TinyML, какие платформы реально доступны в 2026 году, развеем главные мифы об edge AI, покажем практические проекты и назовём приборы, без которых отладка таких систем превращается в угадайку.

![]() Время чтения: 21 минута

Время чтения: 21 минута

Что такое NPU и зачем он нужен

CPU делает всё. GPU делает всё параллельно. NPU делает одно — но быстрее всех.

Обычный центральный процессор (CPU) — это универсальный солдат. Он умеет и строки парсить, и числа складывать, и в интернет ходить. Но нейросеть — это миллионы операций умножения и сложения матриц. CPU выполняет их последовательно: берёт первую пару чисел, умножает, складывает, переходит к следующей. Для инференса (вывода) в реальном времени это слишком медленно и неприемлемо: задержки большие, а энергопотребление растёт.

GPU (графический процессор) изначально создавался для параллельных вычислений, поэтому он справляется с нейросетями лучше. Но потребляет он сотни ватт. В батарейном IoT‑датчике или носимом устройстве его попросту не заметить, есть нет желания таскать с собой ещё и дизель-генератор. Для облака — пойдёт, но тогда всё упирается в передачу данных и сопутствующие ограничения.

Решение — NPU (нейросетевой процессор). Это специализированный ускоритель, оптимизированный строго под матричные операции инференса. В реальных задачах он оказывается в 10–100 раз быстрее CPU при 10–100 раз меньшем потреблении на одну операцию. Это достигается за счёт архитектуры, ориентированной на умножение и накопление (MAC) в целочисленных форматах — INT8, INT4 и т. д.

Что означает TOPS и почему это не единственный критерий

TOPS (Tera Operations Per Second) — это тера (триллион) операций в секунду. Но цифра TOPS бессмысленна без контекста, так как зависит от типа данных. INT8 TOPS — это операции с 8-битными целыми числами. FP16 TOPS — с 16-битными числами с плавающей точкой. 100 TOPS в INT8 не равны 100 TOPS в FP16. Кроме того, архитектура памяти, пропускная способность шины данных и поддерживаемые операции также критичны. TOPS — это как мощность двигателя: важна, но не единственный критерий, который позволяет оценить динамику автомобиля.

100 TOPS в INT8 может проигрывать 20 TOPS в FP16 на вашей модели, если алгоритму важна точность дробных чисел. Производитель может указать пиковые TOPS, но реальная скорость инференса модели зависит от того, насколько эффективно NPU справляется с конкретными слоями нейросети.

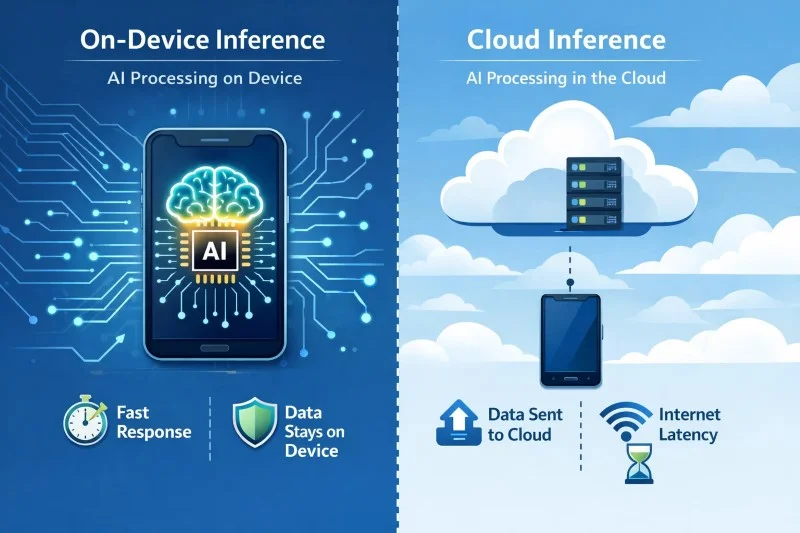

Локальный вывод против облака

On-device inference (инференс на устройстве) принципиально важен по нескольким причинам:

- Латентность — миллисекунды против сотен миллисекунд или секунд.

- Приватность — видеопоток, голос, данные о жестах никуда не уходят.

- Автономность — устройство работает даже без интернета.

- Стоимость — после закупки железа вы не платите за каждое обращение к облаку.

Однако путь к этому у производителей микроконтроллеров был долгим:

- В 2015–2018 годах для TinyML использовали Cortex-M4 с ручной оптимизацией кода и библиотекой CMSIS-NN.

- В 2020 году появился Cortex-M55 с расширениями Helium, а затем — Arm Ethos-U55, первый микро-NPU для встраиваемых систем.

- В 2024–2025 годах STMicroelectronics выпустила STM32N6 — первый STM32 с полноценным NPU на борту (Ethos-U65, 600 GOPS).

- Параллельно Ambiq разработала Apollo 5 с ultra-low-power NPU для батарейных устройств.

Сегодня микрокомпьютеры с ИИ на борту — это уже не лабораторная экзотика, а серийные компоненты. Причём нынешнему разработчику есть из чего выбирать.

Платформы для DIY edge AI в 2026 году

Рынок AI-платформ для DIY-проектов в 2026 году предлагает решения на любой бюджет и задачу. Ниже — таблица доступных платформ с их ключевыми характеристиками.

| Платформа | Чип | AI‑ускоритель | RAM | Сильная сторона |

| Raspberry Pi 5 | Broadcom BCM2712 | Нет NPU | до 8 ГБ | Универсальный, Python/Linux |

| Raspberry Pi AI HAT+ | Hailo‑8L (13 TOPS) | 13 TOPS | — | RPi5 + AI HAT = полноценный NPU для RPi |

| NVIDIA Jetson Orin Nano | Ampere GPU + DLA | 40 TOPS | 4/8 ГБ | Лучший edge‑AI, видеоаналитика |

| Arduino Nano 33 BLE | nRF52840 | Нет NPU | 256 КБ | Базовый TinyML, Edge Impulse |

| ESP32‑S3 | Xtensa LX7 dual | Нет NPU | 512 КБ | Дешёвый, Wi‑Fi+BLE, TensorFlow Lite Micro |

| Qualcomm RB3 Gen 2 | QCS6490, Hexagon NPU | ~15 TOPS | 8 ГБ | Производительный edge AI + камеры |

| Ambiq Apollo 5 | Cortex‑M55 + ETM | Micro NPU | 4 МБ | Ultra‑low‑power TinyML, батарейное питание |

| STM32N6 | Cortex‑M55 + NPU | 600 GOPS | 4 МБ | Первый STM32 с настоящим NPU |

Есть три уровня входа:

- Хочу попробовать TinyML — ESP32‑S3 (300–500 ₽) или Arduino Nano 33 BLE. Плюс бесплатный Edge Impulse. Уже за выходные получите распознавание жестов или ключевых слов.

- Хочу серьёзный edge AI проект — Jetson Orin Nano или Qualcomm RB3 Gen 2. Десятки TOPS, полноценное компьютерное зрение, работа с несколькими камерами, промышленная надёжность.

- Хочу батарейный AI‑датчик — Ambiq Apollo 5 или STM32N6. Микроамперы в режиме сна, активный инференс за десятки милливатт. Идеально для носимых устройств и автономных сенсоров.

Выбор зависит от бюджета, задачи и опыта.

Новые доступные платформы 2026: что реально изменилось

STM32N6 — это не маркетинг. Это первый STM32 с настоящим NPU на борту.

Когда STMicroelectronics выпустила STM32N6, сообщество вздохнуло с облегчением. Наконец‑то знакомая экосистема: привычный HAL, CubeIDE, отладчики ST‑Link — и всё это с аппаратным ускорителем нейросетей на базе Arm Cortex‑M55 + Ethos‑U65 NPU производительностью 600 GOPS (INT8).

ST CubeAI позволяет конвертировать обученные модели TensorFlow Lite или ONNX в код для NPU без глубоких знаний ML. Для тех, кто уже работал с STM32, переход практически безболезненный.

Затем появился Apollo 5 — микроконтроллер, который потребляет сотни наноампер в спящем режиме и единицы микроватт при активном инференсе. Он открыл дверь для носимых устройств с голосовым управлением, которые работают месяцами от батарейки‑таблетки. Если вам нужен всегда работающий детектор ключевых слов без зарядки — Apollo 5 лучший кандидат.

Raspberry Pi 5 уже сам по себе мощная платформа, но для серьёзного AI на борту не хватало аппаратного ускорителя. AI HAT+ подключается через PCIe и даёт 13 TOPS, работая в паре с обычным Python‑кодом. Вся экосистема Linux остаётся доступной, а инференс моделей становится в разы быстрее.

Затем ESP32‑S3. У него нет NPU. Но двухъядерный Xtensa LX7 с SIMD‑инструкциями и поддержкой TensorFlow Lite Micro позволяет запускать многие модели: детекцию ключевых слов, классификацию жестов по IMU, простую классификацию звуков. Плюс встроенные Wi‑Fi и BLE.

Что изменилось по сравнению с 2023–2024:

- Доступность SDK — Edge Impulse, NanoEdge AI Studio, ST CubeAI позволяют собирать, обучать и разворачивать модели без написания кода нейросетей.

- Рост числа pre‑trained моделей — на Model Zoo появились модели, оптимизированные именно для NPU.

- Снижение цен — платы с NPU стали стоить как нормальные отладочные наборы, а не как промышленные компьютеры.

Для первого проекта берите ESP32‑S3 + Edge Impulse. Для серьёзного встроенного продукта — STM32N6 или Jetson Orin Nano в зависимости от задач.

Что NPU умеет, а что нет

Честный разговор о разрыве между маркетингом и реальностью.

NPU — это мощный инструмент, но важно понимать его ограничения. Ниже — таблица распространённых заблуждений и реальности.

| Распространённое заблуждение | Как на самом деле |

| NPU умеет всё, что умеет GPU | NPU оптимизирован строго под матричные операции инференса. Обучение моделей, физические расчёты, рендеринг — не его задача. |

| Больше TOPS = лучше для моего проекта T | OPS зависят от типа данных (INT8 vs FP16) и архитектуры. 100 TOPS в INT8 может проиграть 20 TOPS в FP16 на вашей модели, если нужна высокая точность. |

| AI‑чип можно подключить к любой модели | Модель должна быть квантизована (INT8/INT4) и скомпилирована под конкретный NPU. Это отдельный этап разработки. |

| NPU всегда потребляет мало энергии | При активной непрерывной работе (continuous inference) потребление может быть значительным. Ultra‑low‑power достигается только при правильном управлении режимами сна и пробуждения. |

| Arduino + Edge Impulse = полноценный AI | Edge Impulse — отличный инструмент, но его возможности ограничены. Простые модели — да; GPT‑подобные задачи — нет. |

| AI‑чип заменит всю электронную начинку | NPU — это ускоритель. Ему нужен host‑процессор, память, интерфейсы. Он не работает сам по себе. |

NPU — это не волшебство. Это специализированный инструмент для конкретных задач. Это основа для реального проекта, который работает, но не надо ждать от него сверхестественного.

Что реально можно сделать с edge AI в DIY

Не голосовой помощник, но достаточно умно, чтобы изменить проект

Разберём несколько прикладных задач, к которым можно «прикрутить» AI, и что из этого получится:

- Голосовое управление без интернета. ESP32-S3 + Edge Impulse + микрофон PDM/I2S. Обучаете собственное ключевое слово (например, «лампочка, включись») за 1–2 часа. Работает с задержкой менее 100 мс. Точность распознавания — 90–95% при правильном обучении модели. Потребление — 20–30 мА в активном режиме. Итог: умная лампа, которой не нужен Wi‑Fi.

- Умная камера с детектированием объектов. Jetson Orin Nano или Raspberry Pi 5 + AI HAT. YOLO-nano или MobileNet SSD + DeepStream SDK. Детектирование людей, транспорта — в реальном времени при лагах менее 30 мс. Реальный кейс: система контроля доступа, подсчёт посетителей, обнаружение опасных зон. FPS: 20–60 в зависимости от модели и разрешения.

- Обнаружение аномалий в вибрации (предиктивное обслуживание). Arduino Nano 33 BLE + акселерометр + Edge Impulse. Обучить модель на «нормальной» вибрации двигателя, ловить отклонения. Реальный кейс: сигнализация об износе подшипника, детектирование дисбаланса. Точность — 85–92%. Латентность — 50–100 мс.

- Обнаружение газа/запаха. МОХ-сенсор (MQ-серия или BME680) + STM32 + TinyML. Классифицировать алкоголь, ацетон, дым, природный газ. Кейс: умный датчик воздуха без облака. Модель обучается на типичных паттернах сопротивления сенсора. Точность — 80–90% при правильной калибровке.

- Распознавание жестов через IMU. MPU6050 или LSM6DS3 + ESP32-S3 + TensorFlow Lite Micro. Жест мышью в воздухе, управление светом, тренажёр реакции. Модель обучается на акселерометре и гироскопе: вы делаете 50–100 повторений жеста, Edge Impulse создаёт модель. Лаги — 40–80 мс.

- AIoT (гибридный инференс). Простые задачи решаются на устройстве (edge), сложные отправляются в облако. Это даёт экономию трафика и батареи. Архитектура для умного дома: на ESP32‑S3 детекция жестов и слов, а сложная обработка речи — в облаке при необходимости.

Пока что не получится на микроконтроллерах с NPU:

- LLM‑задачи (диалоговые модели, текстовые генерации) — им нужны гигабайты памяти и терафлопсы.

- Сложный NLU (понимание естественного языка).

- Генерация изображений.

Для этих задач нужен сервер, а не устройство на батарейке.

Какие приборы нужны для работы с AI‑чипами

AI‑чипы — это новое поколение сложных SoC. Их отладка требует нового подхода и специфических измерительных приборов. Ниже — таблица ключевых особенностей и необходимого оборудования.

| Особенность AI‑чипа | Какой прибор нужен и зачем |

| Несколько типов питания (1,0 В / 1,8 В / 3,3 В) | Лабораторный блок питания с точной установкой + осциллограф для проверки сигналов и просадок при AI‑нагрузке |

| Пиковое потребление при инференсе (burst current) | Мультиметр с True-RMS или электронная нагрузка: измерить реальный ток в момент запуска модели |

| Высокоскоростные интерфейсы (MIPI CSI, USB 3, PCIe) | Осциллограф с полосой 200+ МГц + логический анализатор с декодерами |

| BGA и QFN корпуса чипов NPU / SoC | Микроскоп, паяльная станция с термофеном — для монтажа и ремонта |

| Тепловой пакет: чип греется при AI‑задачах | Тепловизор или пирометр: контроль температуры NPU под нагрузкой для выбора системы охлаждения |

| Отладка прошивки / модели inference | Логический анализатор (UART/JTAG), осциллограф, программатор |

| Ультра‑низкое потребление (Ambiq, STM32N6 sleep) | Мультиметр в режиме мкА или пикоамперметр для измерений |

Самое неочевидное требование AI‑чипов — питание. NPU при запуске модели создаёт пиковое потребление в 2–5 раз выше idle. Если лабораторный блок питания не позволяет чётко ограничить ток, а осциллограф не показывает просадки, вы рискуете сжечь платы или годами ловить сбои.

Высокоскоростные интерфейсы (MIPI CSI для камер, USB 3 для Jetson) требуют осциллографа с полосой от 200 МГц. На 50‑МГц приборе вы просто не увидите MIPI CSI‑2.

Термодиагностика тоже актуальна: современные SoC под нагрузкой AI‑задачи греются значительно сильнее, чем в idle. Тепловизор или пирометр — практичный инструмент для оценки теплового пакета и выбора системы охлаждения.

Все перечисленные приборы — осциллографы, лабораторные блоки питания, логические анализаторы, программаторы STM32, тепловизоры и пирометры — представлены в каталоге Суперайс. Подбирайте инструмент под свою задачу.

С чего начать ваш первый AI‑проект

Есть три пути в edge AI — в зависимости от вашего бюджета, опыта и задачи.

Путь 1: нулевой бюджет, максимальный опыт Arduino

ESP32-S3 DevKit + бесплатный аккаунт Edge Impulse. За выходные можно создать работающий детектор слов или классификатор жестов. Edge Impulse предоставляет полный рабочий набор: запись данных, обучение модели, экспорт в C++ для Arduino IDE. Это самый быстрый путь в TinyML без глубоких знаний ML.

Путь 2: средний бюджет, серьёзный опыт

Возьмите STM32N6 Discovery Kit + STM CubeAI + NanoEdge AI Studio. STM32N6 Discovery Kit — это обычная STM32-плата, но с настоящим встроенным NPU Ethos-U65. Чтобы запустить на ней нейросеть, не нужно быть специалистом по ML: в экосистеме ST уже есть CubeAI — инструмент, который автоматически берёт модель из TensorFlow, Keras или PyTorch и превращает её в оптимизированный C-код. То есть вы обучаете модель как обычно, нажимаете «конвертировать», и на выходе получаете готовую функцию, которую можно вызывать прямо из прошивки.

Путь 3: максимальные возможности

Здесь нужны Jetson Orin Nano (~18 000 ₽) + NVIDIA TAO Toolkit + DeepStream SDK. Компьютерное зрение в реальном времени, несколько камер одновременно, CUDA-ускорение. TAO Toolkit позволяет обучать модели без глубоких знаний ML — transfer learning из pre-trained моделей NVIDIA. DeepStream — фреймворк для видеоаналитики с поддержкой RTSP, H.264/H.265, MQTT.

Инструменты разработки. Edge Impulse (браузерный, без ML-опыта) — лучший выбор для начинающих. NanoEdge AI Studio (ST, без ML-опыта) — для задач аномалий на STM32. TensorFlow Lite Micro (Python-опыт нужен) — для тех, кто хочет контроля над моделью. NVIDIA TAO (advanced) — для компьютерного зрения на Jetson.

Не ждите идеального момента. ESP32-S3 + Edge Impulse — это 2 часа до первого работающего проекта. Купили модуль, зарегистрировались в Edge Impulse, записали 50 образцов своего ключевого слова, обучили модель, скачали библиотеку, загрузили в Arduino IDE, прошили. Работает.

AI‑чипы в 2026 — это реальные инструменты, которые сделали порог входа в AI-инжиниринг ниже, чем кажется. Распознавание слов, жестов, анализ — вот что DIY edge AI умеет по‑настоящему хорошо. И для большинства практических задач этого достаточно.

Если вы хотите работать с NPU, внимательно отнеситесь к питанию, тепловой нагрузке и отладке — и подберите правильные инструменты. Всё необходимое для работы с AI-чипами — осциллографы, ЛБП, логические анализаторы, программаторы и термодиагностика — доступно в каталоге Суперайс.

79

79

122

122

144

144